KAN: De Volgende Stap in AI-Netwerken?

n.v.t., donderdag, 24 oktober 2024.

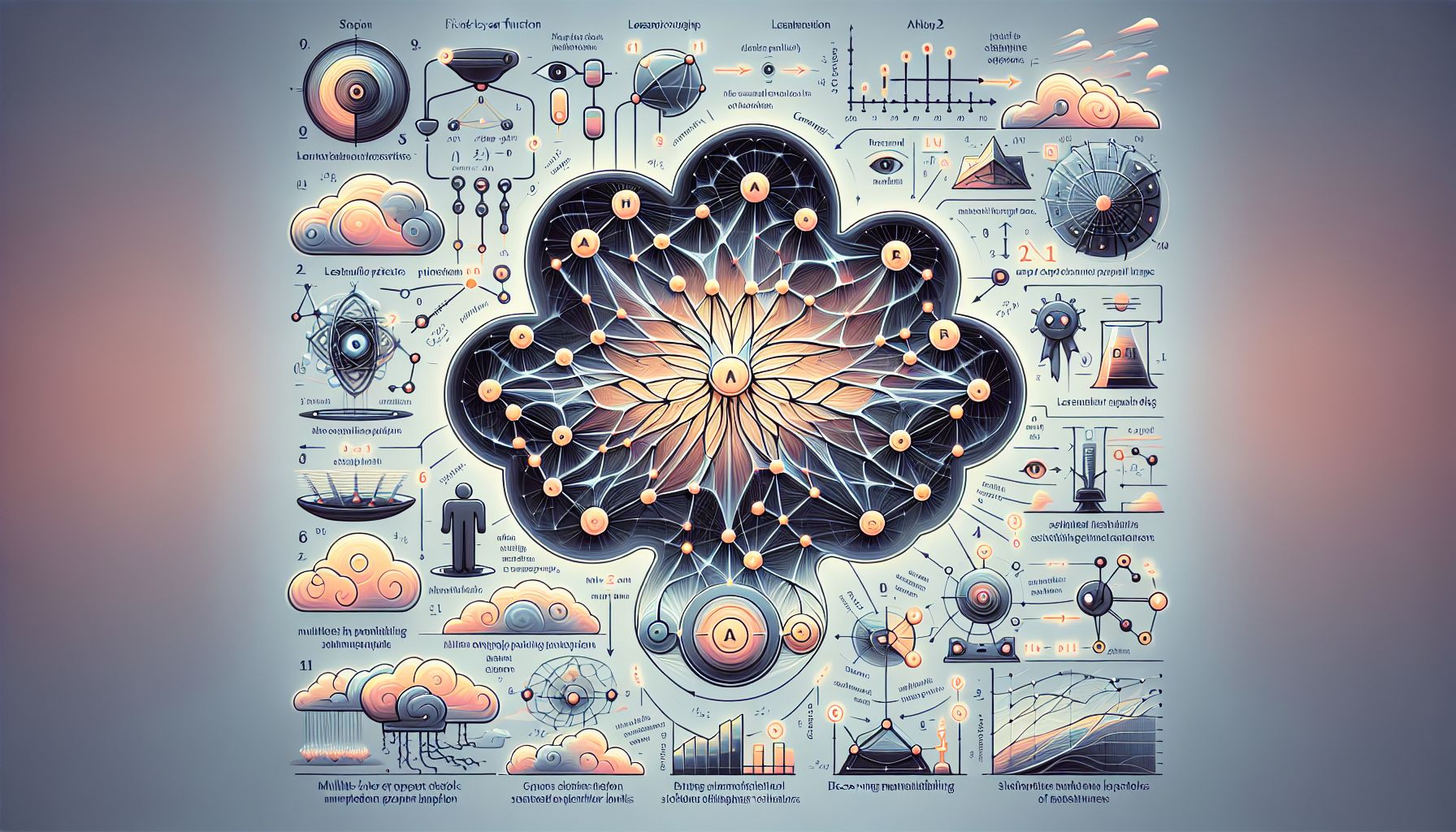

Kolmogorov-Arnold Netwerken (KANs) dagen de traditionele Multi-Layer Perceptrons (MLPs) uit in de wereld van deep learning. Deze innovatieve netwerken vervangen vaste activatiefuncties door leerbare functies op de verbindingen, wat leidt tot verhoogde nauwkeurigheid en betere interpreteerbaarheid. KANs presteren beter met minder parameters, vertonen snellere neurale schalingswetten en bieden intuïtieve visualisatiemogelijkheden. Ze helpen zelfs wetenschappers bij het (her)ontdekken van wiskundige en natuurkundige wetten. Deze veelbelovende ontwikkeling opent nieuwe deuren voor de verbetering van huidige deep learning-modellen en zou wel eens de toekomst van AI kunnen vormgeven.

De Opkomst van Kolmogorov-Arnold Netwerken

Kolmogorov-Arnold Netwerken (KANs) zijn gebaseerd op de Kolmogorov-Arnold representatiestelling, een wiskundige basis die de leerbaarheid en flexibiliteit van deze netwerken versterkt. In tegenstelling tot de traditionele Multi-Layer Perceptrons (MLPs), die gebruikmaken van vaste activatiefuncties, maken KANs gebruik van leerbare functies op de randen, wat een grotere nauwkeurigheid en interpretatie mogelijk maakt. Dit betekent dat zelfs kleinere KANs beter of vergelijkbaar kunnen presteren dan grotere MLPs in het fitten van data en het oplossen van partiële differentiaalvergelijkingen[1].

Voordelen van KANs in Deep Learning

De voordelen van KANs in de wereld van deep learning zijn talrijk. Ze bieden niet alleen een grotere nauwkeurigheid, maar ook een snellere neurale schaalwet, waardoor ze efficiënter zijn in het verwerken van complexe datasets. Daarnaast kunnen KANs intuïtief worden gevisualiseerd, wat een betere interactie met gebruikers mogelijk maakt en een dieper begrip van de onderliggende processen biedt. Deze eigenschap maakt KANs bijzonder nuttig in samenwerking met wetenschappers voor het (her)ontdekken van wiskundige en natuurkundige wetten[1].

De Impact op AI-ontwikkeling

KANs zouden wel eens een revolutie teweeg kunnen brengen in de manier waarop AI-modellen worden ontwikkeld en toegepast. Door de flexibiliteit en leerbaarheid van de activatiefuncties kunnen deze netwerken zich aanpassen aan een breed scala van toepassingen, van geavanceerde data-analyse tot het modelleren van complexe systemen. De potentiële toepassingen zijn divers en bieden mogelijkheden voor verdere innovatie in AI, met name in sectoren waar precisie en interpretatie cruciaal zijn[1].

Toekomstige Uitdagingen en Mogelijkheden

Hoewel KANs veelbelovend zijn, staan ze ook voor uitdagingen. De complexiteit van het ontwerpen en trainen van deze netwerken vereist een diepgaand begrip van zowel de onderliggende wiskunde als de praktische implementaties. Bovendien moeten onderzoekers de balans vinden tussen de kracht van KANs en de benodigde rekenkracht, vooral bij grootschalige toepassingen. Desalniettemin biedt de voortdurende ontwikkeling van KANs een spannende weg vooruit voor AI-onderzoekers en -ontwikkelaars, met de belofte van efficiëntere en meer interpreteerbare AI-modellen[1].